机器心脏编辑:Chen Ping,最近,熊猫,AI Ascent的OpenAI研究 - 由红杉资本赞助

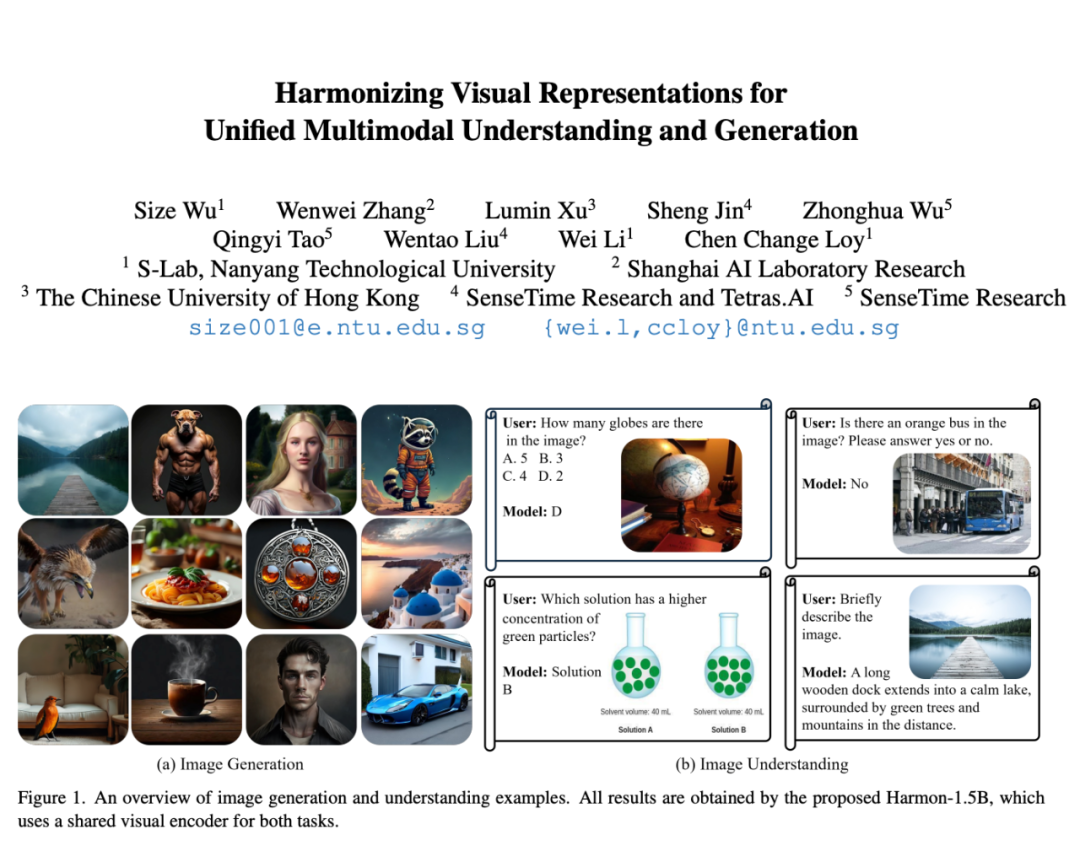

机器的心脏编辑:最近,由红杉资本赞助的AI Ascent的Panda,Chen Ping,OpenIAI研究科学家丹·罗伯茨(Dan Roberts)发表了关于“下一个未来 /扩展的强化学习”主题的讲话。上传到YouTube的版本采用了一个更具吸引力的内容:“ 9年来实现AGI?Openai的Dan Roberts想知道爱因斯坦的状况如何。”在这次演讲中,丹·罗伯茨(Dan Roberts)介绍了预训练的缩放缩放比例和强化,并预测,强化研究将来将在建立AI模型中发挥重要作用。随着教育的不断扩大,我们最终将创建能够发现新科学的模型。 https://www.youtube.com/watch?他还用Sho Yaida编写了《深度学习理论原理》,并在Arxiv中发表了免费版本:https://arxiv.org/abs/2106.10165。在建立Diffeo之前,他还曾在Facebook AI研究中心担任研究科学家。与采矿文本合作进行国防,情报和金融服务的产品 - 一家最终收购了Salesforce的公司,并加入了Dan Roberts的Salesforce。后来,他加入了红杉首都并成为AI同伴。去年,他离开了红杉资本,并加入了Openai。丹·罗伯茨(Dan Roberts)的讲话之后,机器的心脏核心。众所周知,9月,Openai发布了一种名为O1的模型。我在这里显示的是一个图,其中y轴代表模型如何在某种基准数学推理上作用,但是真正有趣的是X轴。左侧的图表表明,尽管训练时间不足,但模型性能会相应提高。每个练习AI模型的人都熟悉这种趋势。但是真正的渴望是右边的图表:它表明,随着“试用时间”的上升,模型的性能也将提高。该模型已经学会了思考,而花在思考的时间越多,您所做的发展就越大。这个盘子RY非常重要,我们甚至在T恤上发布了它。因为它代表了一个全新的扩展规模 - 不仅扩大了训练时间,而且还扩大了测试时间。这个发现是什么意思?这意味着我们有一个可以考虑的模型。上个月,我们发布了一个更强的O3理解模型,例如图中所示的草稿图,您可以询问“解决左侧的问题”。来源:https://openai.com/index/thinking-with-images/这种类型的模型可以思考,分析图像和扩大图像图像和扩大图像详细信息(在试验过程中)。实际上,这张纸上有一个feynman图(用于表示音量字段理论的图。最后提供了正确的答案 - 整个过程大约需要一分钟。因此,答案可以做什么。我们可以做什么?一个模型可以在一分钟的思维中完成一些复杂的计算,但是我们的目标不超过这一点。但是,我们不得创建一个思维的实验!当它思考时!得分,谁是最好的?阿尔伯特·爱因斯坦。让我们与爱因斯坦做一个假设:如果我们回到1907年(在他开始学习一般家庭之前),让他回答有关大个子亲戚的最终测试问题 - 这个问题实际上与gpt -4.5结合在一起,但是我可以确定这确实是您可以找到的那种问题。我们认为爱因斯坦在1907年被问到以下问题:问题1:黑洞和施瓦兹的监管。当然,作为Openai,我们不会直接问爱因斯坦,而是“爱因斯坦V1907-Super-Hacks”。我认为爱因斯坦是一种视觉思维。她总是想用电梯和自由跌倒作为例子 - 在研究一个大亲戚时,他肯定会发现这些概念,以及橡胶膜中小球的隐喻。但是,他似乎从一半的一半思考的音量机制中分心(我们的模型经常像这样分心!)。看来“爱因斯坦的V1907-Super-Hacks”的想法正在慢慢接近Conc黑洞的ept ...但是我不知道他为什么把自己置于这些场景中。但是答案是正确的。但是事实证明,GPT-4.5未能正确回答这个问题,我们不得不依靠O3来解决它。我在OpenAI上的工作可能是要专门验证这些物理计算,而不是进行AI研究。但关键是:该模型给出了正确的答案,爱因斯坦·伊斯普雷(Einstein Ispre)正确地回答了 - 他只花了8年了。当前,我们的模型可以通过一分钟的思考来复制教科书级别的计算及其衍生问题。但是我们的目标不仅仅是 - 我们希望他们能在人类知识和科学领先做出重大贡献。让我们回到该图表(左侧)如何实现此目标?从图表可以看出,模型性能会随着训练量的增加而提高,我们的培训方法主要是对加固的研究(RL)。我想在大多数演讲中传达的主要信息是:我们需要继续o扩大加固研究的大小。一年前,我们发布了GPT-4O,当时所有计算资源都投资于预培训。但是随后我们开始探索新的方向,这导致了在当今测试阶段“思考”的能力 - 例如,在O1模型中,我们添加了研究的增强量(RL Compute)。当然,这只是一个卡通演示,比例不正确,但方向是正确的。 O3使用一些刺激研究,但是增强研究计算的比例将来会更大。从某些角度来看,计算增强研究可能是主导的。这是我从Yann Lecun的幻灯片中借来的照片,也许是她在2019年发表的演讲。这张幻灯片有点复杂且难以理解。关键是:预训练就像这个大蛋糕一样,加固的研究应类似于上面的小樱桃。我们真正需要做的就是放弃模因。我们蛋糕的大小可能不会改变,但我们可能对教育进行了超大的研究。那么,我们打算做什么?但是我无法应付我们的计划。我起初记得我的幻灯片会有些削减,但是一切都还好。我们的计划真的很明显:规模扩展计算。这是什么意思?我们将筹集5000亿美元在德克萨斯州阿比林(Abilene)购买一些土地,建造一些建筑物,并在上面放一些计算机。我们还将培训一些模型,并希望从中获得很多收入,然后我们将建造许多建筑物并在其上放更多的计算机。这就是我们可以测量计算的方法。同时,我们还将开发缩放科学,这是我在Openai所做的。该图像来自介绍GPT-4的博客文章,当时我不加入Openaiat,但是这张图像确实令人兴奋。下面的绿点是GPT-4性能的最终损失,在训练过程中记录的性能之前的灰点。该图使用对数刻度。通过连接这些要点,我们将得到一个我们可以用来预测未来的趋势线:尚未发生的培训大型模型可以带来好处。现在,我们有一个新的方向来计算测试时间和增强学习。我们是否必须离开所有内容并重新创建将其应用于扩展计算的含义?因此,我们需要扩展科学。此图像来自播客主持人Dwarkesh。他问,因为LLM记得今天有很多知识,为什么他没有发现这一发现?达希兰可能错误地问了这个问题。在研究中,探究方法通常比研究过程和答案更为重要。因此,关键是提出正确的问题。另一个可能的原因是,我们现在将破坏竞争和其他问题的数学问题,从而导致该模型在各种问题中的不平坦能力。不过,我认为真正发生的是衡量。我们需要进行更多测量,这是值得的。总而言之,这就是接下来会发生的事情。去年是AI上升的图表,Y轴是半载体。可以看出,代理/AI可以每7个月处理的任务长度。根据此图像,他们可以进行最多一个小时的测试,但是明年呢?这可能是2到3个小时。但是,预测AI的发展并不容易,一切总是错误的。但是,如果到2034年,此图预测是正确的,并且AI将有能力进行8年的计算和思考 - 而8年正是爱因斯坦用来发现大亲戚的时间。我认为大概在9年的时间里,我们将有一个可以发现大亲戚的模型。

机器的心脏编辑:最近,由红杉资本赞助的AI Ascent的Panda,Chen Ping,OpenIAI研究科学家丹·罗伯茨(Dan Roberts)发表了关于“下一个未来 /扩展的强化学习”主题的讲话。上传到YouTube的版本采用了一个更具吸引力的内容:“ 9年来实现AGI?Openai的Dan Roberts想知道爱因斯坦的状况如何。”在这次演讲中,丹·罗伯茨(Dan Roberts)介绍了预训练的缩放缩放比例和强化,并预测,强化研究将来将在建立AI模型中发挥重要作用。随着教育的不断扩大,我们最终将创建能够发现新科学的模型。 https://www.youtube.com/watch?他还用Sho Yaida编写了《深度学习理论原理》,并在Arxiv中发表了免费版本:https://arxiv.org/abs/2106.10165。在建立Diffeo之前,他还曾在Facebook AI研究中心担任研究科学家。与采矿文本合作进行国防,情报和金融服务的产品 - 一家最终收购了Salesforce的公司,并加入了Dan Roberts的Salesforce。后来,他加入了红杉首都并成为AI同伴。去年,他离开了红杉资本,并加入了Openai。丹·罗伯茨(Dan Roberts)的讲话之后,机器的心脏核心。众所周知,9月,Openai发布了一种名为O1的模型。我在这里显示的是一个图,其中y轴代表模型如何在某种基准数学推理上作用,但是真正有趣的是X轴。左侧的图表表明,尽管训练时间不足,但模型性能会相应提高。每个练习AI模型的人都熟悉这种趋势。但是真正的渴望是右边的图表:它表明,随着“试用时间”的上升,模型的性能也将提高。该模型已经学会了思考,而花在思考的时间越多,您所做的发展就越大。这个盘子RY非常重要,我们甚至在T恤上发布了它。因为它代表了一个全新的扩展规模 - 不仅扩大了训练时间,而且还扩大了测试时间。这个发现是什么意思?这意味着我们有一个可以考虑的模型。上个月,我们发布了一个更强的O3理解模型,例如图中所示的草稿图,您可以询问“解决左侧的问题”。来源:https://openai.com/index/thinking-with-images/这种类型的模型可以思考,分析图像和扩大图像图像和扩大图像详细信息(在试验过程中)。实际上,这张纸上有一个feynman图(用于表示音量字段理论的图。最后提供了正确的答案 - 整个过程大约需要一分钟。因此,答案可以做什么。我们可以做什么?一个模型可以在一分钟的思维中完成一些复杂的计算,但是我们的目标不超过这一点。但是,我们不得创建一个思维的实验!当它思考时!得分,谁是最好的?阿尔伯特·爱因斯坦。让我们与爱因斯坦做一个假设:如果我们回到1907年(在他开始学习一般家庭之前),让他回答有关大个子亲戚的最终测试问题 - 这个问题实际上与gpt -4.5结合在一起,但是我可以确定这确实是您可以找到的那种问题。我们认为爱因斯坦在1907年被问到以下问题:问题1:黑洞和施瓦兹的监管。当然,作为Openai,我们不会直接问爱因斯坦,而是“爱因斯坦V1907-Super-Hacks”。我认为爱因斯坦是一种视觉思维。她总是想用电梯和自由跌倒作为例子 - 在研究一个大亲戚时,他肯定会发现这些概念,以及橡胶膜中小球的隐喻。但是,他似乎从一半的一半思考的音量机制中分心(我们的模型经常像这样分心!)。看来“爱因斯坦的V1907-Super-Hacks”的想法正在慢慢接近Conc黑洞的ept ...但是我不知道他为什么把自己置于这些场景中。但是答案是正确的。但是事实证明,GPT-4.5未能正确回答这个问题,我们不得不依靠O3来解决它。我在OpenAI上的工作可能是要专门验证这些物理计算,而不是进行AI研究。但关键是:该模型给出了正确的答案,爱因斯坦·伊斯普雷(Einstein Ispre)正确地回答了 - 他只花了8年了。当前,我们的模型可以通过一分钟的思考来复制教科书级别的计算及其衍生问题。但是我们的目标不仅仅是 - 我们希望他们能在人类知识和科学领先做出重大贡献。让我们回到该图表(左侧)如何实现此目标?从图表可以看出,模型性能会随着训练量的增加而提高,我们的培训方法主要是对加固的研究(RL)。我想在大多数演讲中传达的主要信息是:我们需要继续o扩大加固研究的大小。一年前,我们发布了GPT-4O,当时所有计算资源都投资于预培训。但是随后我们开始探索新的方向,这导致了在当今测试阶段“思考”的能力 - 例如,在O1模型中,我们添加了研究的增强量(RL Compute)。当然,这只是一个卡通演示,比例不正确,但方向是正确的。 O3使用一些刺激研究,但是增强研究计算的比例将来会更大。从某些角度来看,计算增强研究可能是主导的。这是我从Yann Lecun的幻灯片中借来的照片,也许是她在2019年发表的演讲。这张幻灯片有点复杂且难以理解。关键是:预训练就像这个大蛋糕一样,加固的研究应类似于上面的小樱桃。我们真正需要做的就是放弃模因。我们蛋糕的大小可能不会改变,但我们可能对教育进行了超大的研究。那么,我们打算做什么?但是我无法应付我们的计划。我起初记得我的幻灯片会有些削减,但是一切都还好。我们的计划真的很明显:规模扩展计算。这是什么意思?我们将筹集5000亿美元在德克萨斯州阿比林(Abilene)购买一些土地,建造一些建筑物,并在上面放一些计算机。我们还将培训一些模型,并希望从中获得很多收入,然后我们将建造许多建筑物并在其上放更多的计算机。这就是我们可以测量计算的方法。同时,我们还将开发缩放科学,这是我在Openai所做的。该图像来自介绍GPT-4的博客文章,当时我不加入Openaiat,但是这张图像确实令人兴奋。下面的绿点是GPT-4性能的最终损失,在训练过程中记录的性能之前的灰点。该图使用对数刻度。通过连接这些要点,我们将得到一个我们可以用来预测未来的趋势线:尚未发生的培训大型模型可以带来好处。现在,我们有一个新的方向来计算测试时间和增强学习。我们是否必须离开所有内容并重新创建将其应用于扩展计算的含义?因此,我们需要扩展科学。此图像来自播客主持人Dwarkesh。他问,因为LLM记得今天有很多知识,为什么他没有发现这一发现?达希兰可能错误地问了这个问题。在研究中,探究方法通常比研究过程和答案更为重要。因此,关键是提出正确的问题。另一个可能的原因是,我们现在将破坏竞争和其他问题的数学问题,从而导致该模型在各种问题中的不平坦能力。不过,我认为真正发生的是衡量。我们需要进行更多测量,这是值得的。总而言之,这就是接下来会发生的事情。去年是AI上升的图表,Y轴是半载体。可以看出,代理/AI可以每7个月处理的任务长度。根据此图像,他们可以进行最多一个小时的测试,但是明年呢?这可能是2到3个小时。但是,预测AI的发展并不容易,一切总是错误的。但是,如果到2034年,此图预测是正确的,并且AI将有能力进行8年的计算和思考 - 而8年正是爱因斯坦用来发现大亲戚的时间。我认为大概在9年的时间里,我们将有一个可以发现大亲戚的模型。